Así puedes reconocer un video falso creado con Inteligencia Artificial

En redes sociales circulan videos de personas reales que emiten un mensaje falso creado por inteligencia artificial. Estos son los llamados deepfakes.

-

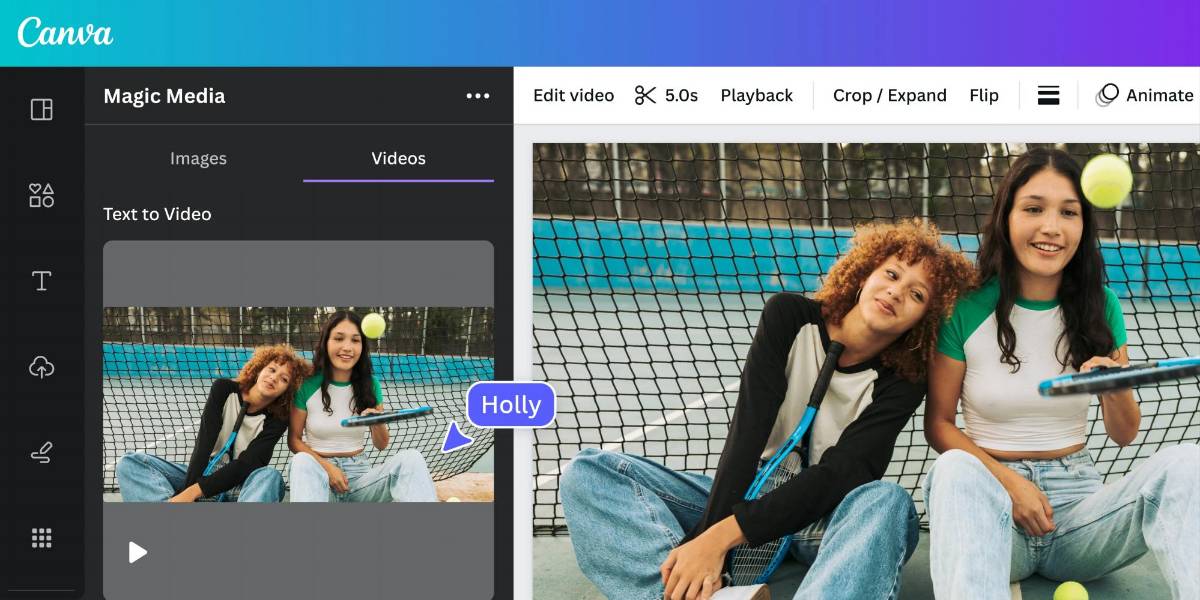

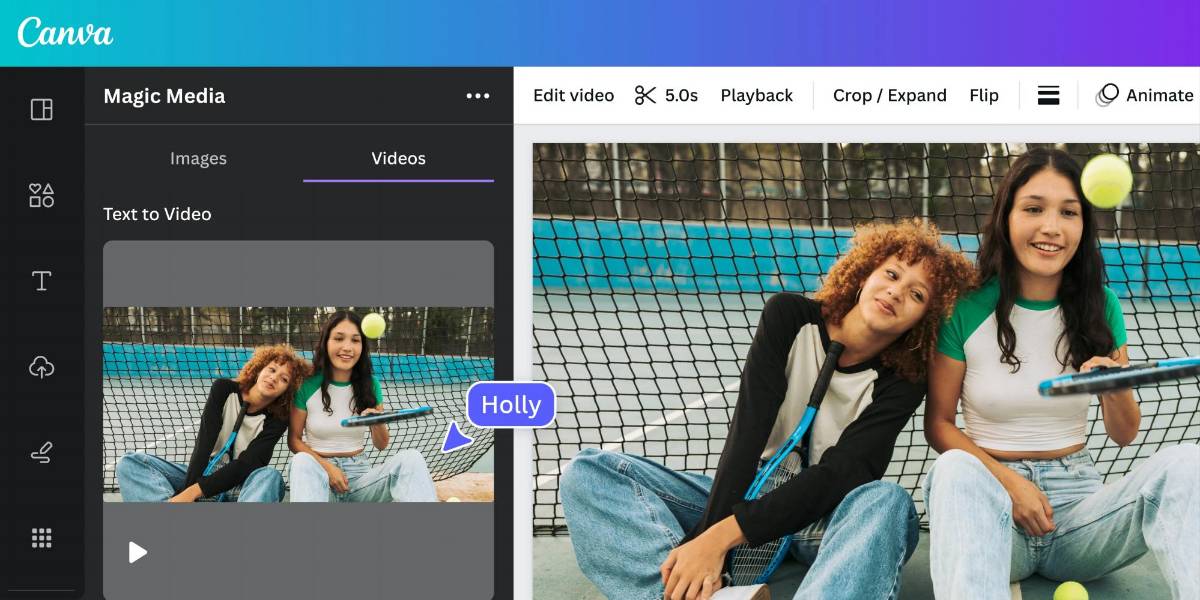

Imagen referencial de video creado con IA. ( )

Imagen referencial de video creado con IA. ( )

En la era digital, donde las imágenes y videos pueden manipularse con facilidad, resulta cada vez más difícil distinguir entre lo real y lo falso. Los llamados deepfakes, creaciones hiperrealistas generadas por inteligencia artificial, han inundado internet, sembrando dudas y desconfianza.

Lea: Apple Intelligence: la inteligencia artificial de Apple llega en octubre

Un deepfake es un contenido sintético, como un video o una imagen, creado a partir de técnicas de aprendizaje profundo. Estos algoritmos permiten intercambiar rostros, crear personas inexistentes o modificar escenas de manera tan convincente que resulta casi imposible detectar la manipulación a simple vista.

La popularización de los deepfakes y la solución

La facilidad con la que se pueden crear deepfakes y su creciente sofisticación han generado una preocupación global. Ante este desafío, el profesor Siwei Lyu de la Universidad de Buffalo ha desarrollado una herramienta gratuita y de acceso público llamada DeepFake-o-meter. Esta plataforma permite a cualquier usuario analizar audios, imágenes y videos para determinar si son auténticos o si han sido generados por IA.

¿Cómo funciona DeepFake-o-meter?

Probando DeepFake-o-meter con ChatGPT

Para poner a prueba la eficacia de esta herramienta, se solicitó a ChatGPT que generara una imagen realista de un parque en un día soleado. Posteriormente, se subió esta imagen a DeepFake-o-meter:

Sin embargo, al analizarla con DeepFake-o-meter, el resultado fue sorprendente: la plataforma indicó que solo había un 13% de probabilidad de que la imagen fuera generada por IA. Si esta imagen 100% hecha por la IA no fue reconocida como tal, en el caso de imágenes modificadas con un alto nivel de detalle, la plataforma puede tener dificultades para detectar la manipulación.

Puede interesarle: Los tres dispositivos que nunca deben estar cerca del router porque ralentizan el Internet

Así pues, aunque DeepFake-o-meter puede ser una herramienta útil para detectar algunos tipos de deepfakes, en esta prueba demostró que no es infalible. A medida que la tecnología avanza, es probable que surjan nuevas y mejores herramientas para identificar este tipo de contenido falso.

Recomendadas